😘Ollama + FastGPT + OneApi 本地部署大模型知识库

打造私有化大模型和知识库在未来个人或者企业都具有相当的吸引力,没有人或者企业想把自己的私有数据公开,但是如何去利用有效地管理和检索,或者说利用大模型有效地发掘数据价值呢?

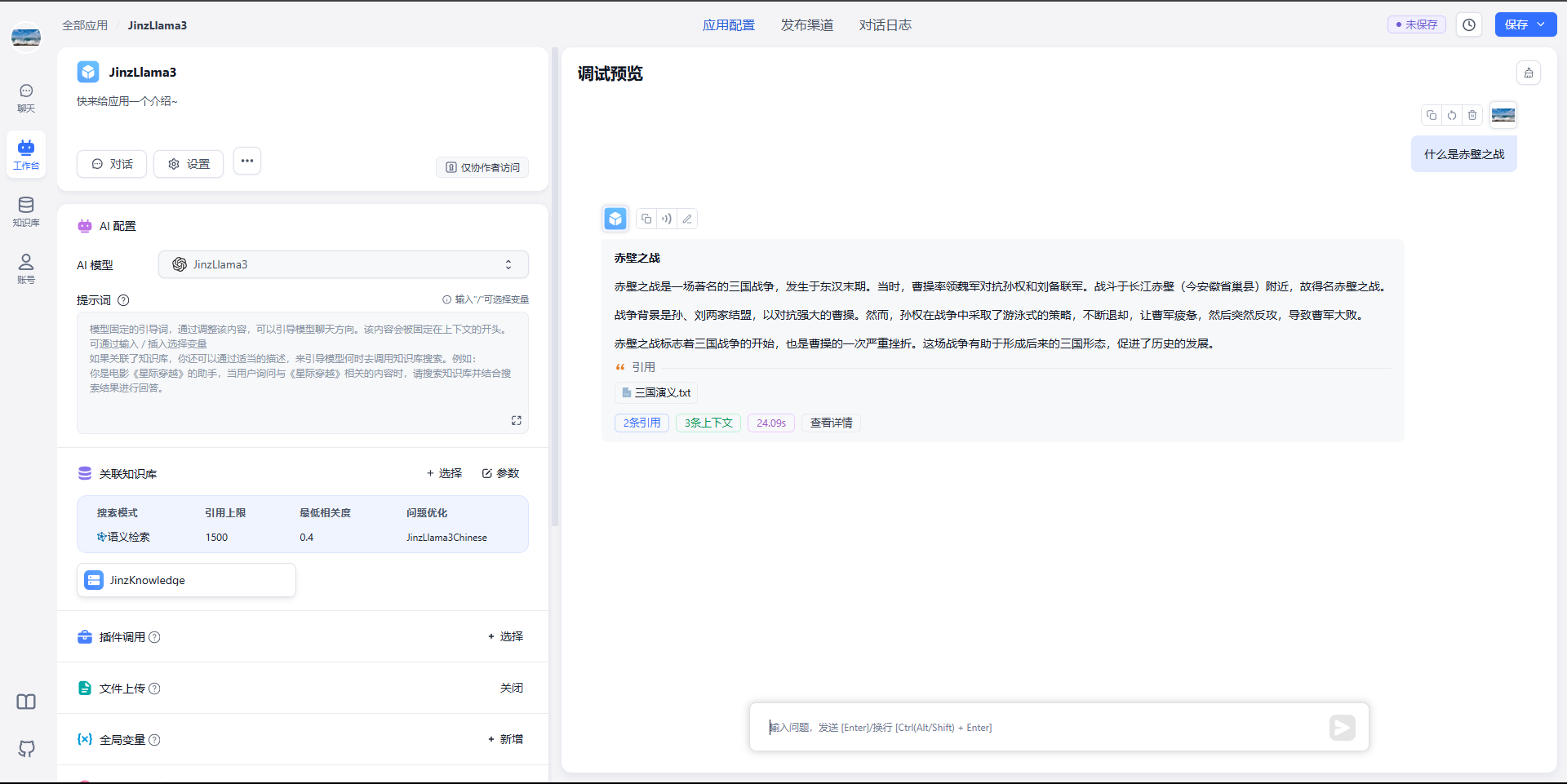

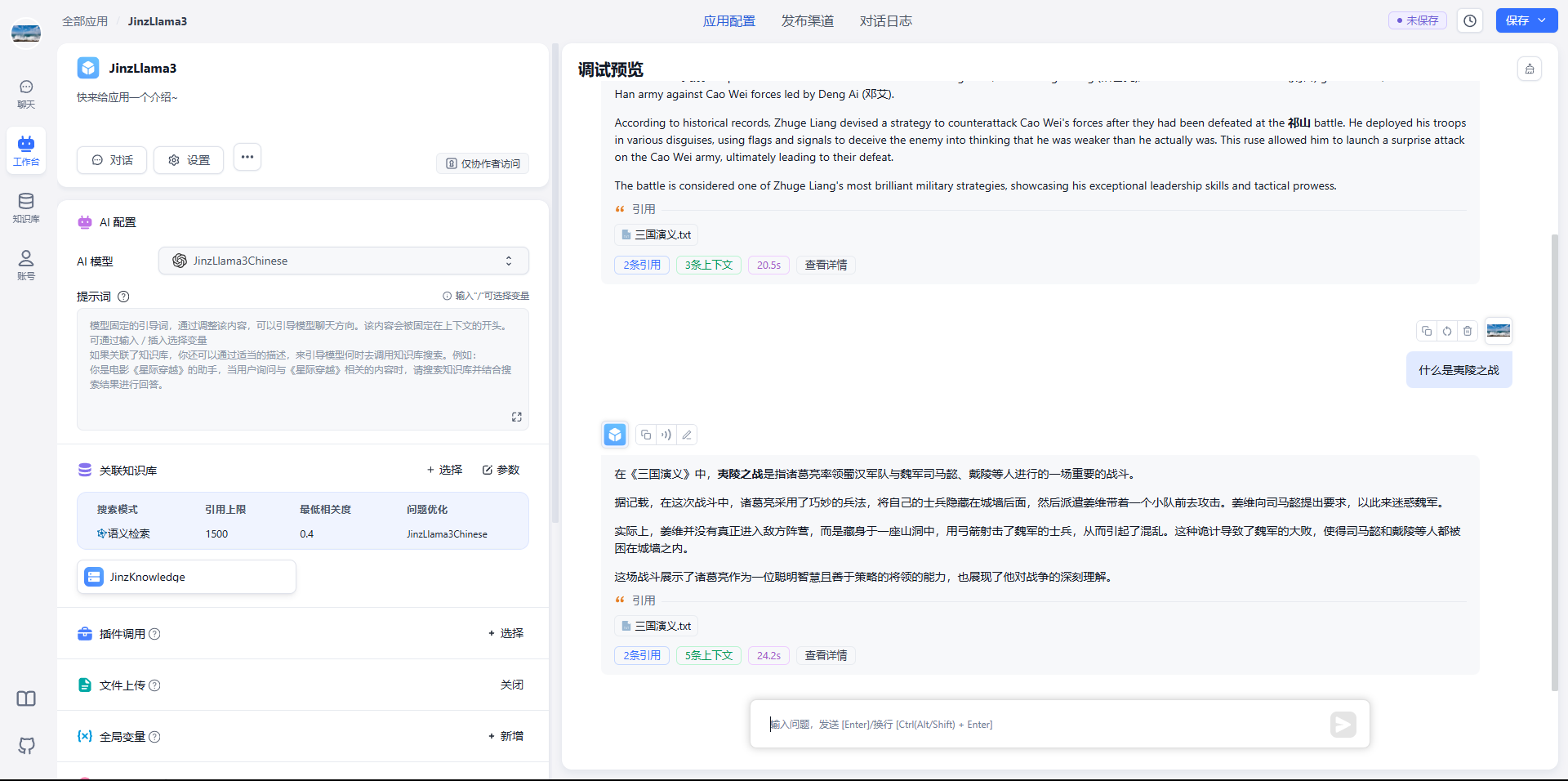

以下是一个例子,我的本地知识库有一个三国演义.txt文件(当然了,文件类别不限,可以是学习笔记,专业知识,行业内幕),假设我对三国演义一无所知,我可以利用本地的私有大模型知识库去问他一些问题:

那么,大模型知识库是如何搭建的呢?以下是我搭建的一些步骤。

Prerequisite & Environment

Prerequisite:完成下列步骤需要docker环境(本机为Docker Desktop v4.25.2),之前文章有提到,这里不再赘述。

Environment:

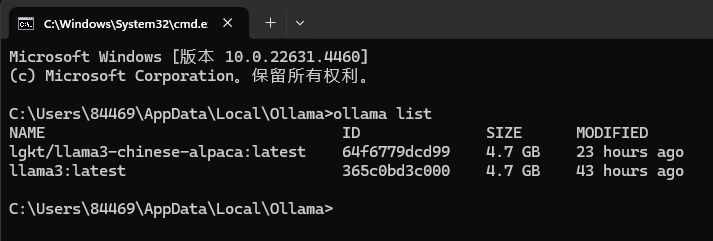

1.Ollama 运行Llama3

先去Ollama 官网下载合适版本的安装包,之后一路下一步安装完成。此时打开路径:C:\Users\username\AppData\Local\Ollama,然后cmd运行如下命令:

ollama run llama3:latest等待模型下载运行起来,可以使用如下命令查看:

ollama list

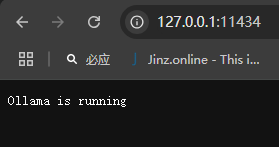

在浏览器输入http://127.0.0.1:11434,查看ollama是否打开服务,否则使用命令:

ollama serve打开浏览器验证如图:

2.安装Fast GPT和OneApi

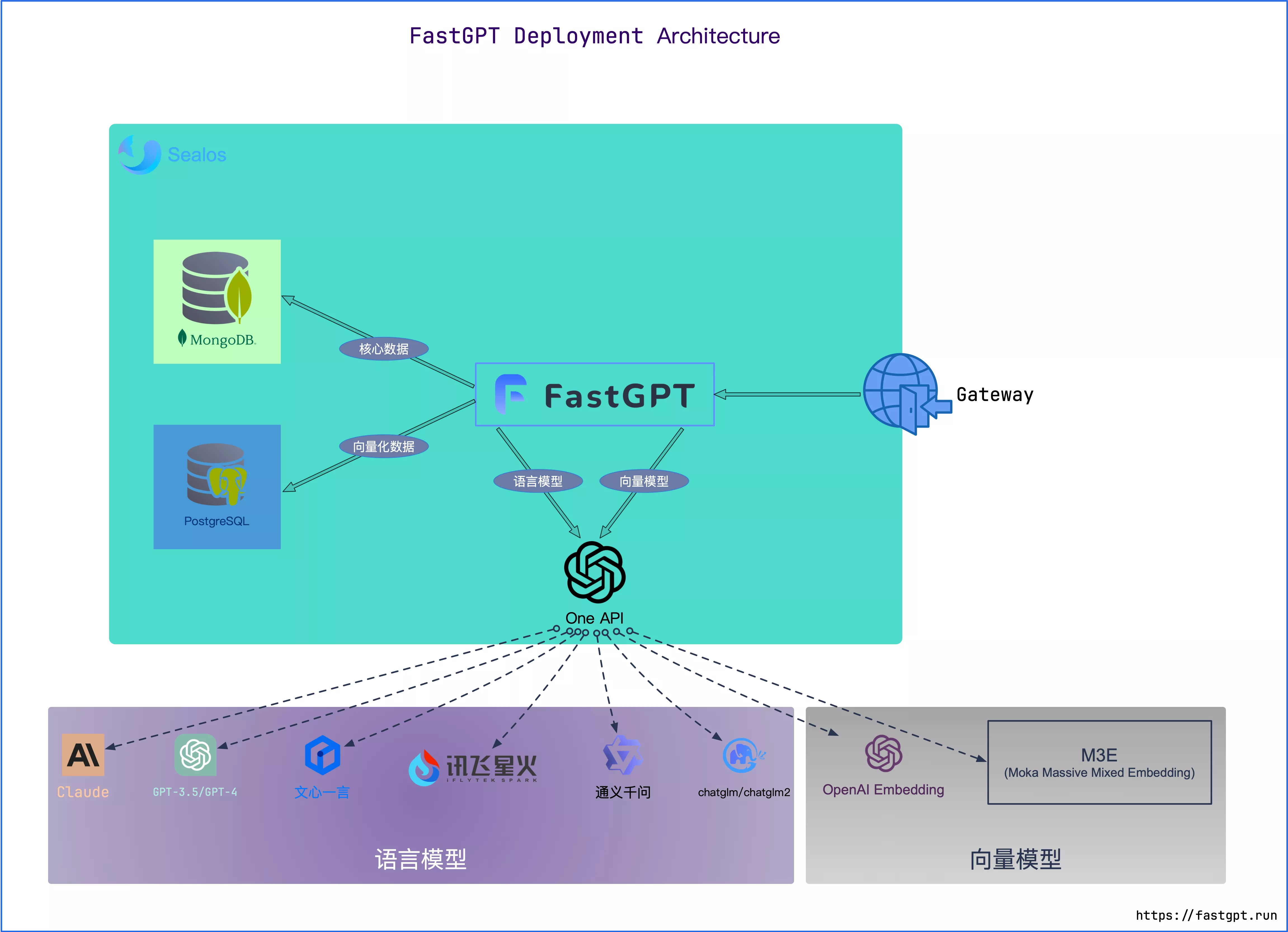

主要根据Fast GPT官网中的Docker Compose 快速部署来做。部署架构图如下:

此处选择的是PgVector版本,docker-compose.yml 文件下载地址,config.json文件下载地址。

修改完成后的docker-compose.yml文件如下:

# 数据库的默认账号和密码仅首次运行时设置有效

# 如果修改了账号密码,记得改数据库和项目连接参数,别只改一处~

# 该配置文件只是给快速启动,测试使用。正式使用,记得务必修改账号密码,以及调整合适的知识库参数,共享内存等。

# 如何无法访问 dockerhub 和 git,可以用阿里云(阿里云没有arm包)

version: '3.3'

services:

# db

pg:

image: pgvector/pgvector:0.7.0-pg15 # docker hub

# image: registry.cn-hangzhou.aliyuncs.com/fastgpt/pgvector:v0.7.0 # 阿里云

container_name: pg

restart: always

ports: # 生产环境建议不要暴露

- 5432:5432

networks:

- fastgpt

environment:

# 这里的配置只有首次运行生效。修改后,重启镜像是不会生效的。需要把持久化数据删除再重启,才有效果

- POSTGRES_USER=username

- POSTGRES_PASSWORD=password

- POSTGRES_DB=postgres

volumes:

- ./pg/data:/var/lib/postgresql/data

mongo:

image: mongo:5.0.18 # dockerhub

# image: registry.cn-hangzhou.aliyuncs.com/fastgpt/mongo:5.0.18 # 阿里云

# image: mongo:4.4.29 # cpu不支持AVX时候使用

container_name: mongo

restart: always

ports:

- 27017:27017

networks:

- fastgpt

command: mongod --keyFile /data/mongodb.key --replSet rs0

environment:

- MONGO_INITDB_ROOT_USERNAME=myusername

- MONGO_INITDB_ROOT_PASSWORD=mypassword

volumes:

- ./mongo/data:/data/db

entrypoint:

- bash

- -c

- |

openssl rand -base64 128 > /data/mongodb.key

chmod 400 /data/mongodb.key

chown 999:999 /data/mongodb.key

echo 'const isInited = rs.status().ok === 1

if(!isInited){

rs.initiate({

_id: "rs0",

members: [

{ _id: 0, host: "mongo:27017" }

]

})

}' > /data/initReplicaSet.js

# 启动MongoDB服务

exec docker-entrypoint.sh "$$@" &

# 等待MongoDB服务启动

until mongo -u myusername -p mypassword --authenticationDatabase admin --eval "print('waited for connection')" > /dev/null 2>&1; do

echo "Waiting for MongoDB to start..."

sleep 2

done

# 执行初始化副本集的脚本

mongo -u myusername -p mypassword --authenticationDatabase admin /data/initReplicaSet.js

# 等待docker-entrypoint.sh脚本执行的MongoDB服务进程

wait $$!

# fastgpt

sandbox:

container_name: sandbox

image: ghcr.io/labring/fastgpt-sandbox:v4.8.11 # git

# image: registry.cn-hangzhou.aliyuncs.com/fastgpt/fastgpt-sandbox:v4.8.11 # 阿里云

networks:

- fastgpt

restart: always

fastgpt:

container_name: fastgpt

image: ghcr.io/labring/fastgpt:v4.8.11 # git

# image: registry.cn-hangzhou.aliyuncs.com/fastgpt/fastgpt:v4.8.11 # 阿里云

ports:

- 3000:3000

networks:

- fastgpt

depends_on:

- mongo

- pg

- sandbox

restart: always

environment:

# root 密码,用户名为: root。如果需要修改 root 密码,直接修改这个环境变量,并重启即可。

- DEFAULT_ROOT_PSW=1234

# AI模型的API地址哦。务必加 /v1。这里默认填写了OneApi的访问地址。

- OPENAI_BASE_URL=http://192.168.208.1:3001/v1

# AI模型的API Key。(这里默认填写了OneAPI的快速默认key,测试通后,务必及时修改)

- CHAT_API_KEY=sk-0hBgesb10jlNW8F13aBcAdA94a7c4cD99f58F1F49bEc7c3d

# 数据库最大连接数

- DB_MAX_LINK=30

# 登录凭证密钥

- TOKEN_KEY=any

# root的密钥,常用于升级时候的初始化请求

- ROOT_KEY=root_key

# 文件阅读加密

- FILE_TOKEN_KEY=filetoken

# MongoDB 连接参数. 用户名myusername,密码mypassword。

- MONGODB_URI=mongodb://myusername:mypassword@mongo:27017/fastgpt?authSource=admin

# pg 连接参数

- PG_URL=postgresql://username:password@pg:5432/postgres

# sandbox 地址

- SANDBOX_URL=http://sandbox:3000

# 前端地址: http://localhost:3000

- FE_DOMAIN=

# 日志等级: debug, info, warn, error

- LOG_LEVEL=info

- STORE_LOG_LEVEL=warn

volumes:

- ./config.json:/app/data/config.json

# oneapi

mysql:

# image: registry.cn-hangzhou.aliyuncs.com/fastgpt/mysql:8.0.36 # 阿里云

image: mysql:8.0.36

container_name: mysql

restart: always

ports:

- 3306:3306

networks:

- fastgpt

command: --default-authentication-plugin=mysql_native_password

environment:

# 默认root密码,仅首次运行有效

MYSQL_ROOT_PASSWORD: oneapimmysql

MYSQL_DATABASE: oneapi

volumes:

- ./mysql:/var/lib/mysql

oneapi:

container_name: oneapi

image: ghcr.io/songquanpeng/one-api:v0.6.7

# image: registry.cn-hangzhou.aliyuncs.com/fastgpt/one-api:v0.6.6 # 阿里云

ports:

- 3001:3000

depends_on:

- mysql

networks:

- fastgpt

restart: always

environment:

# mysql 连接参数

- SQL_DSN=root:oneapimmysql@tcp(mysql:3306)/oneapi

# 登录凭证加密密钥

- SESSION_SECRET=oneapikey

# 内存缓存

- MEMORY_CACHE_ENABLED=true

# 启动聚合更新,减少数据交互频率

- BATCH_UPDATE_ENABLED=true

# 聚合更新时长

- BATCH_UPDATE_INTERVAL=10

# 初始化的 root 密钥(建议部署完后更改,否则容易泄露)

- INITIAL_ROOT_TOKEN=fastgpt

volumes:

- ./oneapi:/data

networks:

fastgpt:修改完成后的config.json文件如下:

// 已使用 json5 进行解析,会自动去掉注释,无需手动去除

{

"feConfigs": {

"lafEnv": "https://laf.dev" // laf环境。 https://laf.run (杭州阿里云) ,或者私有化的laf环境。如果使用 Laf openapi 功能,需要最新版的 laf 。

},

"systemEnv": {

"vectorMaxProcess": 15, // 向量处理线程数量

"qaMaxProcess": 15, // 问答拆分线程数量

"tokenWorkers": 50, // Token 计算线程保持数,会持续占用内存,不能设置太大。

"pgHNSWEfSearch": 100 // 向量搜索参数。越大,搜索越精确,但是速度越慢。设置为100,有99%+精度。

},

"llmModels": [

{

"model": "lgkt/llama3-chinese-alpaca:latest", // 模型名(对应OneAPI中渠道的模型名)

"name": "JinzLlama3Chinese", // 模型别名

"avatar": "/imgs/model/openai.svg", // 模型的logo

"maxContext": 125000, // 最大上下文

"maxResponse": 16000, // 最大回复

"quoteMaxToken": 120000, // 最大引用内容

"maxTemperature": 1.2, // 最大温度

"charsPointsPrice": 0, // n积分/1k token(商业版)

"censor": false, // 是否开启敏感校验(商业版)

"vision": true, // 是否支持图片输入

"datasetProcess": true, // 是否设置为文本理解模型(QA),务必保证至少有一个为true,否则知识库会报错

"usedInClassify": true, // 是否用于问题分类(务必保证至少有一个为true)

"usedInExtractFields": true, // 是否用于内容提取(务必保证至少有一个为true)

"usedInToolCall": true, // 是否用于工具调用(务必保证至少有一个为true)

"usedInQueryExtension": true, // 是否用于问题优化(务必保证至少有一个为true)

"toolChoice": true, // 是否支持工具选择(分类,内容提取,工具调用会用到。)

"functionCall": false, // 是否支持函数调用(分类,内容提取,工具调用会用到。会优先使用 toolChoice,如果为false,则使用 functionCall,如果仍为 false,则使用提示词模式)

"customCQPrompt": "", // 自定义文本分类提示词(不支持工具和函数调用的模型

"customExtractPrompt": "", // 自定义内容提取提示词

"defaultSystemChatPrompt": "", // 对话默认携带的系统提示词

"defaultConfig": {}, // 请求API时,挟带一些默认配置(比如 GLM4 的 top_p)

"fieldMap": {} // 字段映射(o1 模型需要把 max_tokens 映射为 max_completion_tokens)

},

{

"model": "llama3:latest", // 模型名(对应OneAPI中渠道的模型名)

"name": "JinzLlama3", // 模型别名

"avatar": "/imgs/model/openai.svg", // 模型的logo

"maxContext": 125000, // 最大上下文

"maxResponse": 16000, // 最大回复

"quoteMaxToken": 120000, // 最大引用内容

"maxTemperature": 1.2, // 最大温度

"charsPointsPrice": 0, // n积分/1k token(商业版)

"censor": false, // 是否开启敏感校验(商业版)

"vision": true, // 是否支持图片输入

"datasetProcess": true, // 是否设置为文本理解模型(QA),务必保证至少有一个为true,否则知识库会报错

"usedInClassify": true, // 是否用于问题分类(务必保证至少有一个为true)

"usedInExtractFields": true, // 是否用于内容提取(务必保证至少有一个为true)

"usedInToolCall": true, // 是否用于工具调用(务必保证至少有一个为true)

"usedInQueryExtension": true, // 是否用于问题优化(务必保证至少有一个为true)

"toolChoice": true, // 是否支持工具选择(分类,内容提取,工具调用会用到。)

"functionCall": false, // 是否支持函数调用(分类,内容提取,工具调用会用到。会优先使用 toolChoice,如果为false,则使用 functionCall,如果仍为 false,则使用提示词模式)

"customCQPrompt": "", // 自定义文本分类提示词(不支持工具和函数调用的模型

"customExtractPrompt": "", // 自定义内容提取提示词

"defaultSystemChatPrompt": "", // 对话默认携带的系统提示词

"defaultConfig": {}, // 请求API时,挟带一些默认配置(比如 GLM4 的 top_p)

"fieldMap": {} // 字段映射(o1 模型需要把 max_tokens 映射为 max_completion_tokens)

},

{

"model": "gpt-4o-mini", // 模型名(对应OneAPI中渠道的模型名)

"name": "gpt-4o-mini", // 模型别名

"avatar": "/imgs/model/openai.svg", // 模型的logo

"maxContext": 125000, // 最大上下文

"maxResponse": 16000, // 最大回复

"quoteMaxToken": 120000, // 最大引用内容

"maxTemperature": 1.2, // 最大温度

"charsPointsPrice": 0, // n积分/1k token(商业版)

"censor": false, // 是否开启敏感校验(商业版)

"vision": true, // 是否支持图片输入

"datasetProcess": true, // 是否设置为文本理解模型(QA),务必保证至少有一个为true,否则知识库会报错

"usedInClassify": true, // 是否用于问题分类(务必保证至少有一个为true)

"usedInExtractFields": true, // 是否用于内容提取(务必保证至少有一个为true)

"usedInToolCall": true, // 是否用于工具调用(务必保证至少有一个为true)

"usedInQueryExtension": true, // 是否用于问题优化(务必保证至少有一个为true)

"toolChoice": true, // 是否支持工具选择(分类,内容提取,工具调用会用到。)

"functionCall": false, // 是否支持函数调用(分类,内容提取,工具调用会用到。会优先使用 toolChoice,如果为false,则使用 functionCall,如果仍为 false,则使用提示词模式)

"customCQPrompt": "", // 自定义文本分类提示词(不支持工具和函数调用的模型

"customExtractPrompt": "", // 自定义内容提取提示词

"defaultSystemChatPrompt": "", // 对话默认携带的系统提示词

"defaultConfig": {}, // 请求API时,挟带一些默认配置(比如 GLM4 的 top_p)

"fieldMap": {} // 字段映射(o1 模型需要把 max_tokens 映射为 max_completion_tokens)

},

{

"model": "gpt-4o",

"name": "gpt-4o",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 4000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": true,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": true,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {},

"fieldMap": {}

},

{

"model": "o1-mini",

"name": "o1-mini",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 65000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": false,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": false,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {

"temperature": 1,

"stream": false

},

"fieldMap": {

"max_tokens": "max_completion_tokens"

}

},

{

"model": "o1-preview",

"name": "o1-preview",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 32000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": false,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": false,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {

"temperature": 1,

"stream": false

},

"fieldMap": {

"max_tokens": "max_completion_tokens"

}

}

],

"vectorModels": [

{

"model": "m3e",

"name": "M3E(测试使用)",

"price": 0.1,

"defaultToken": 500,

"maxToken": 1800

},

{

"model": "text-embedding-ada-002", // 模型名(与OneAPI对应)

"name": "Embedding-2", // 模型展示名

"avatar": "/imgs/model/openai.svg", // logo

"charsPointsPrice": 0, // n积分/1k token

"defaultToken": 700, // 默认文本分割时候的 token

"maxToken": 3000, // 最大 token

"weight": 100, // 优先训练权重

"defaultConfig": {}, // 自定义额外参数。例如,如果希望使用 embedding3-large 的话,可以传入 dimensions:1024,来返回1024维度的向量。(目前必须小于1536维度)

"dbConfig": {}, // 存储时的额外参数(非对称向量模型时候需要用到)

"queryConfig": {} // 参训时的额外参数

},

{

"model": "text-embedding-3-large",

"name": "text-embedding-3-large",

"avatar": "/imgs/model/openai.svg",

"charsPointsPrice": 0,

"defaultToken": 512,

"maxToken": 3000,

"weight": 100,

"defaultConfig": {

"dimensions": 1024

}

},

{

"model": "text-embedding-3-small",

"name": "text-embedding-3-small",

"avatar": "/imgs/model/openai.svg",

"charsPointsPrice": 0,

"defaultToken": 512,

"maxToken": 3000,

"weight": 100

}

],

"reRankModels": [],

"audioSpeechModels": [

{

"model": "tts-1",

"name": "OpenAI TTS1",

"charsPointsPrice": 0,

"voices": [

{ "label": "Alloy", "value": "alloy", "bufferId": "openai-Alloy" },

{ "label": "Echo", "value": "echo", "bufferId": "openai-Echo" },

{ "label": "Fable", "value": "fable", "bufferId": "openai-Fable" },

{ "label": "Onyx", "value": "onyx", "bufferId": "openai-Onyx" },

{ "label": "Nova", "value": "nova", "bufferId": "openai-Nova" },

{ "label": "Shimmer", "value": "shimmer", "bufferId": "openai-Shimmer" }

]

}

],

"whisperModel": {

"model": "whisper-1",

"name": "Whisper1",

"charsPointsPrice": 0

}

}将这两个文件放在同一个文件夹,然后输入如下命令下载docker镜像并运行容器:

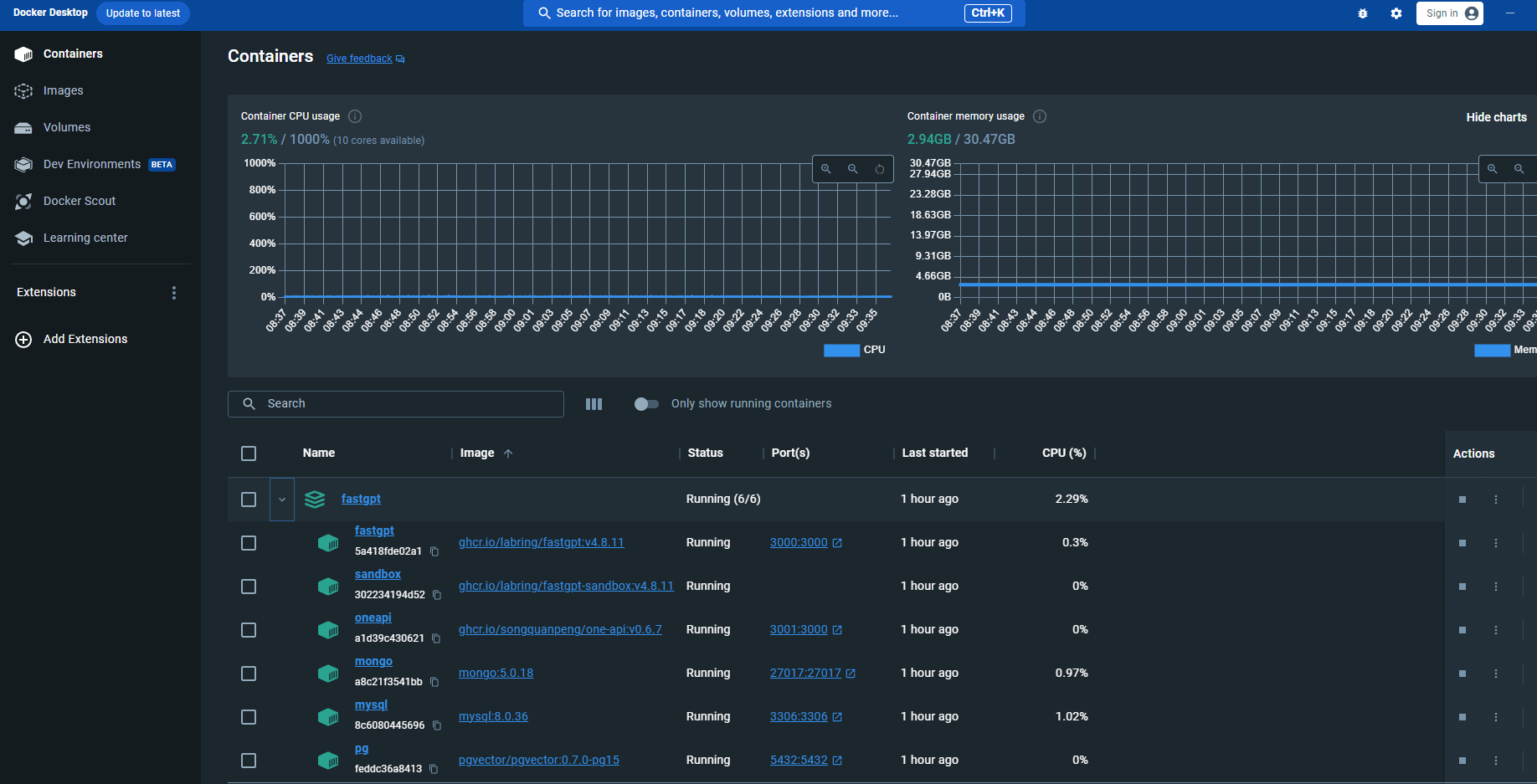

docker-compose up -d

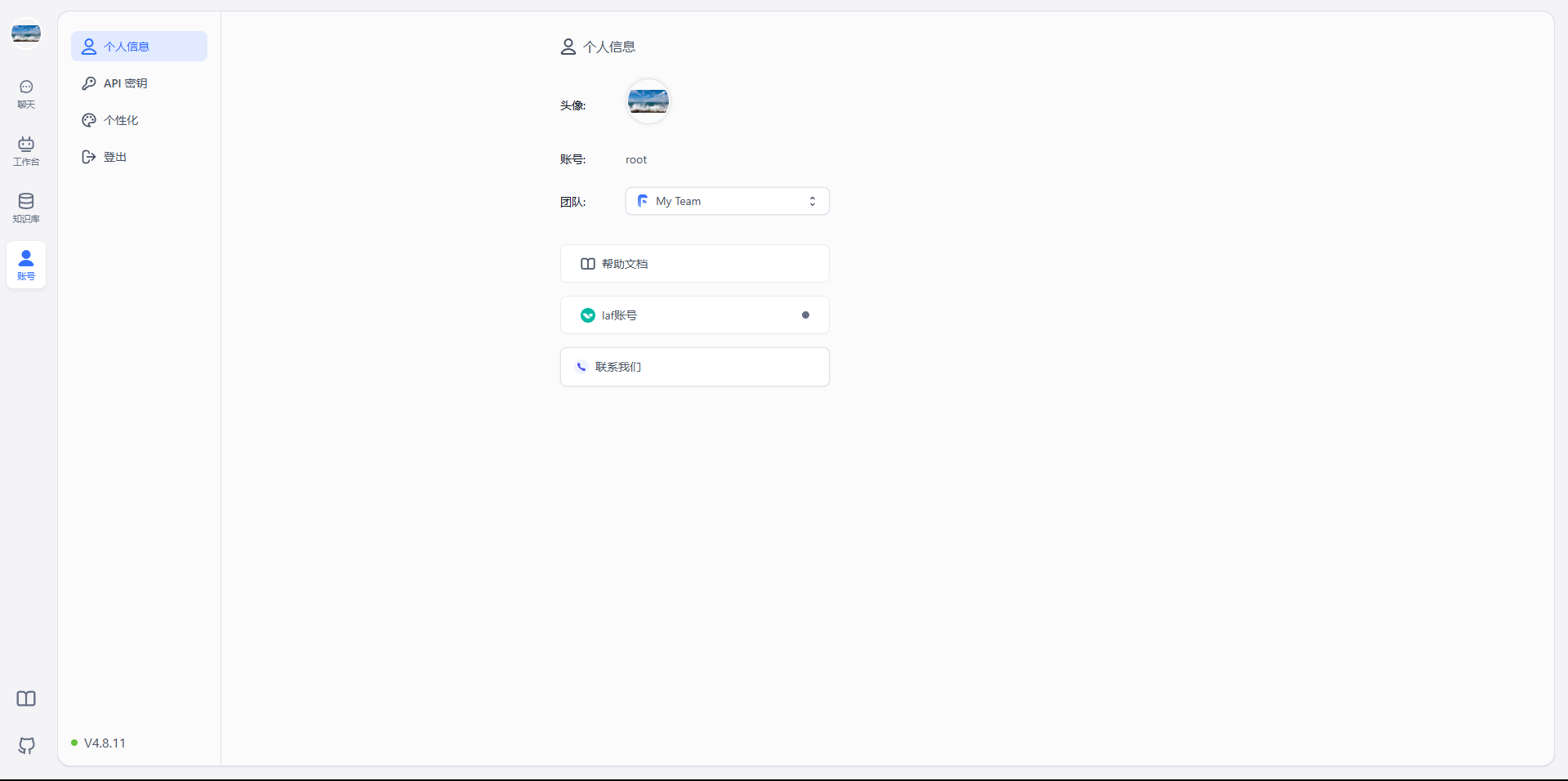

使用网址:http://127.0.0.1:3000 访问Fast GPT页面。初始默认账号密码:账号:root 密码:1234

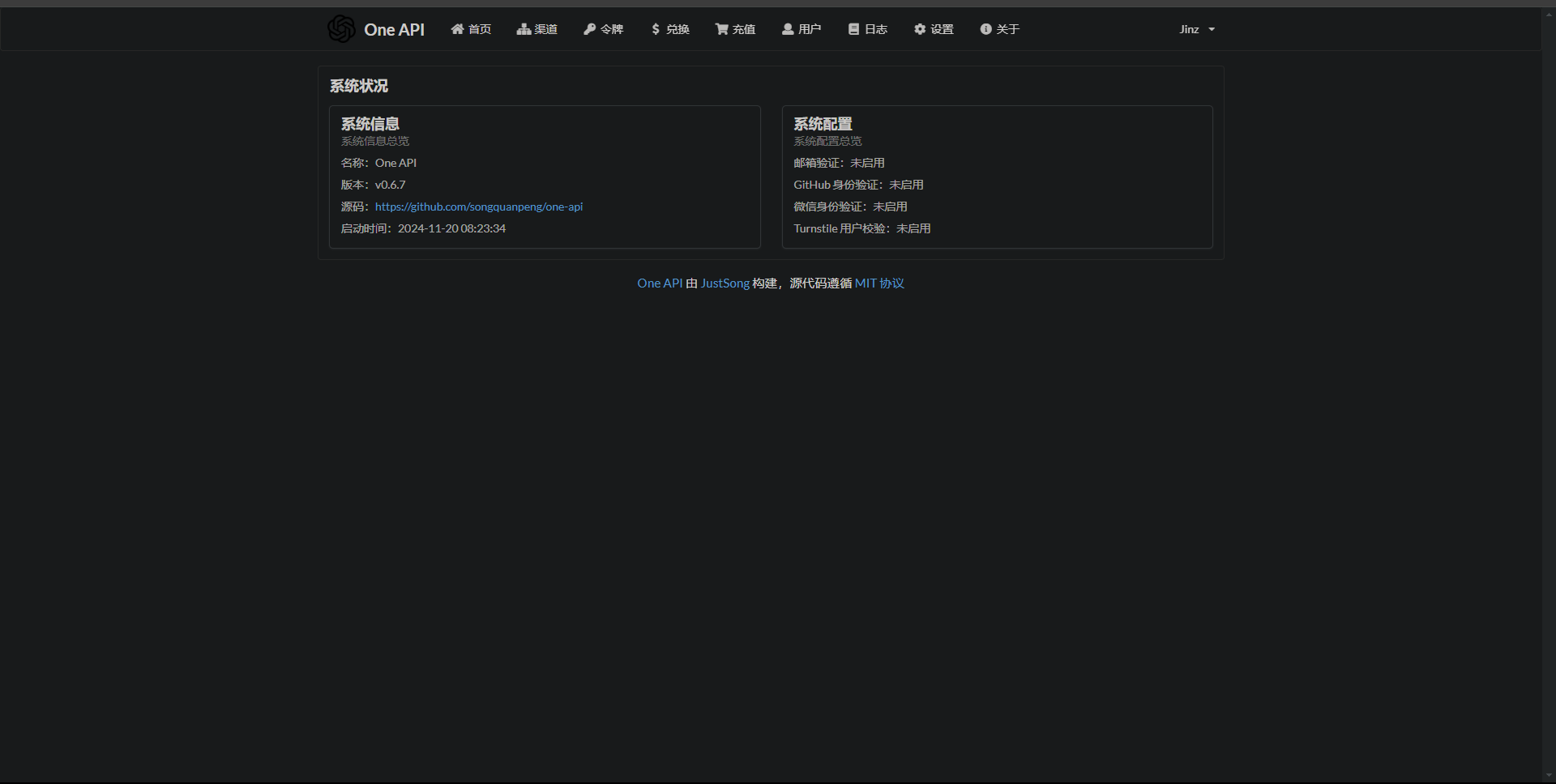

使用 http://127.0.0.1:3001 访问One Api 页面。初始默认账号密码:账号:root 密码:123456

3.安装向量模型m3e

使用docker命令安装向量模型m3e:

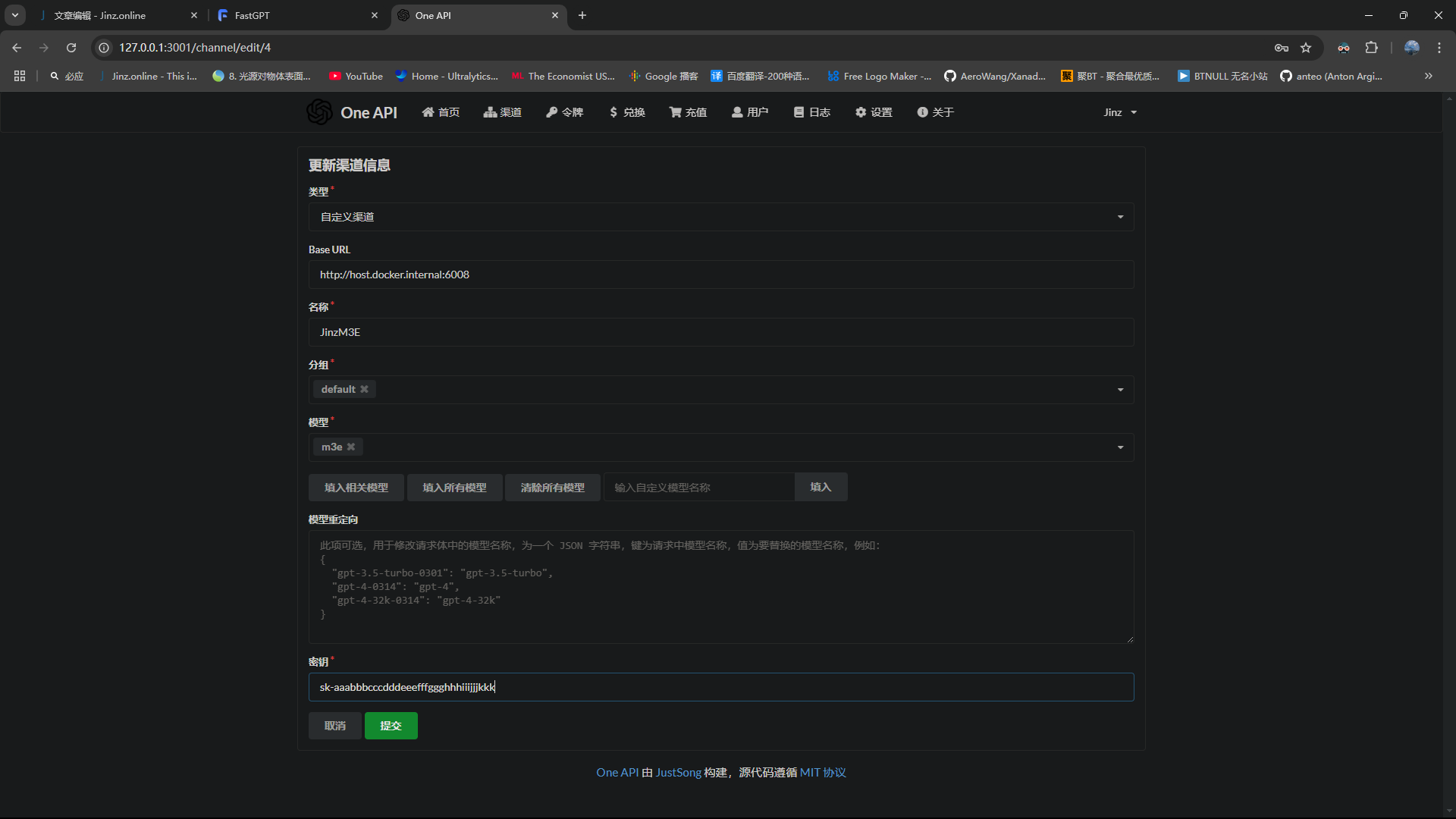

docker run -d -p 6008:6008 --name=m3e-large-api stawky/m3e-large-api:latest默认密钥为:sk-aaabbbcccdddeeefffggghhhiiijjjkkk

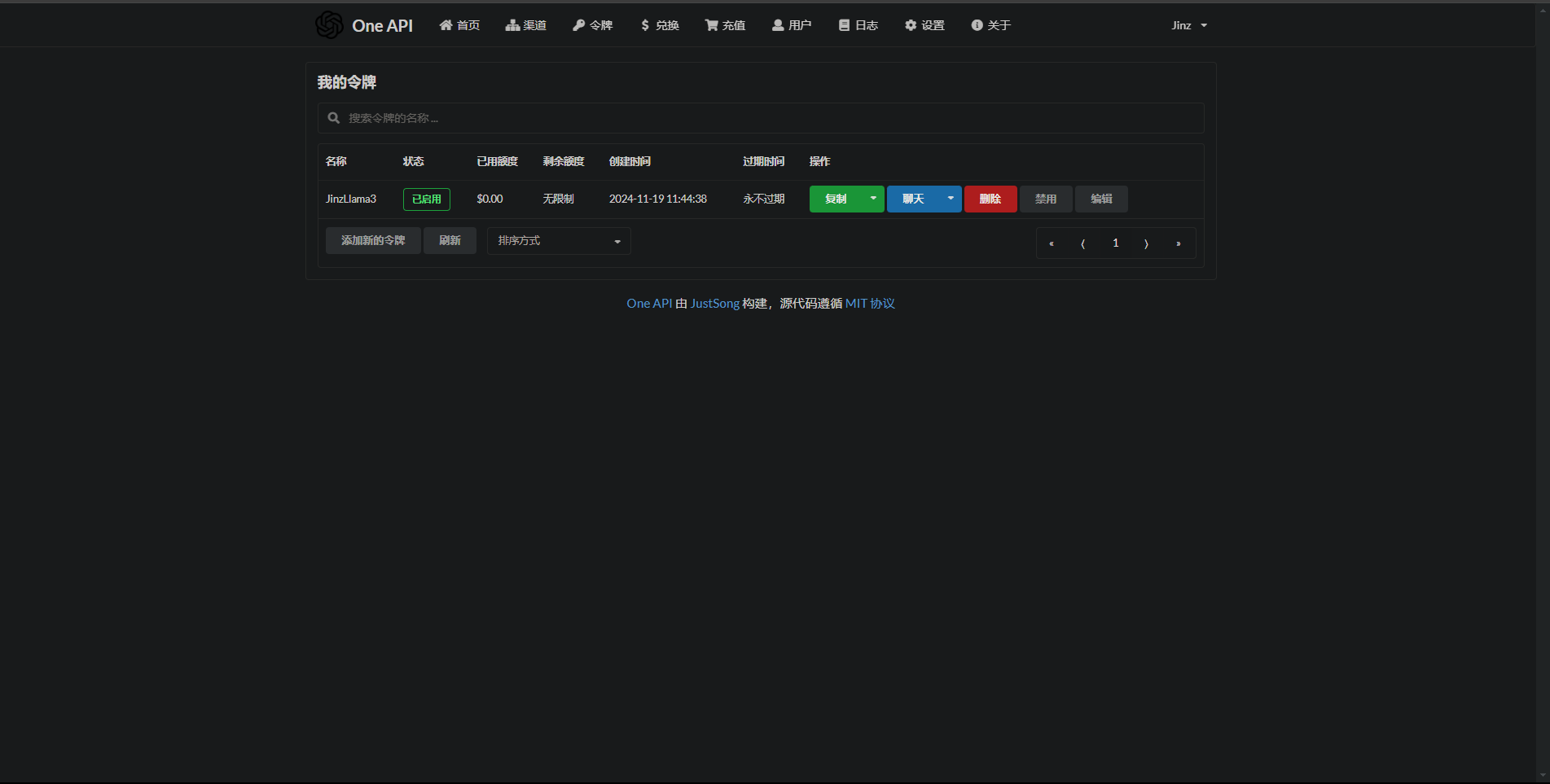

4.OneApi配置渠道及创建令牌

进入OneApi页面配置渠道:

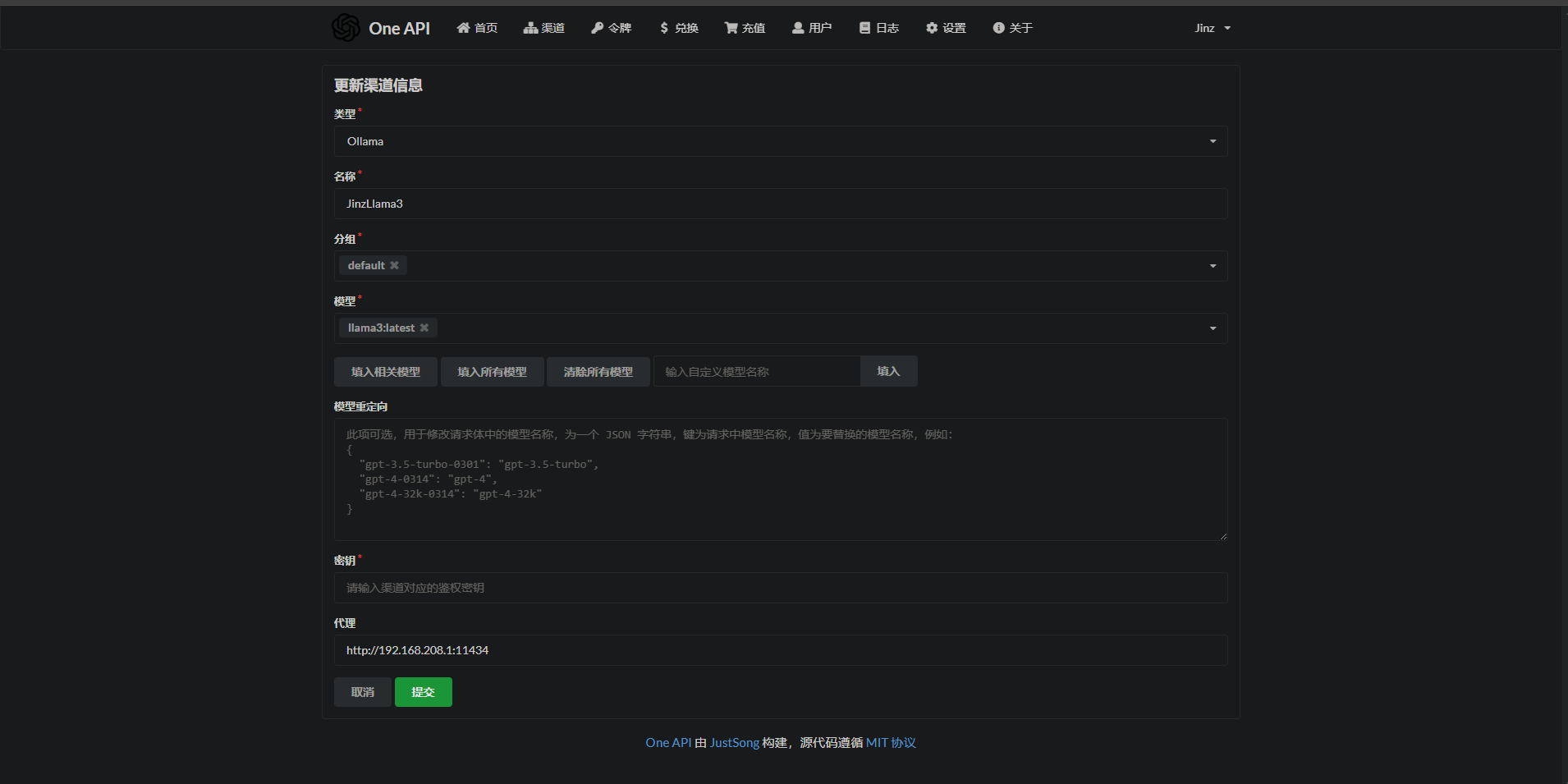

4.1.Llama3渠道配置

4.2.m3e渠道配置

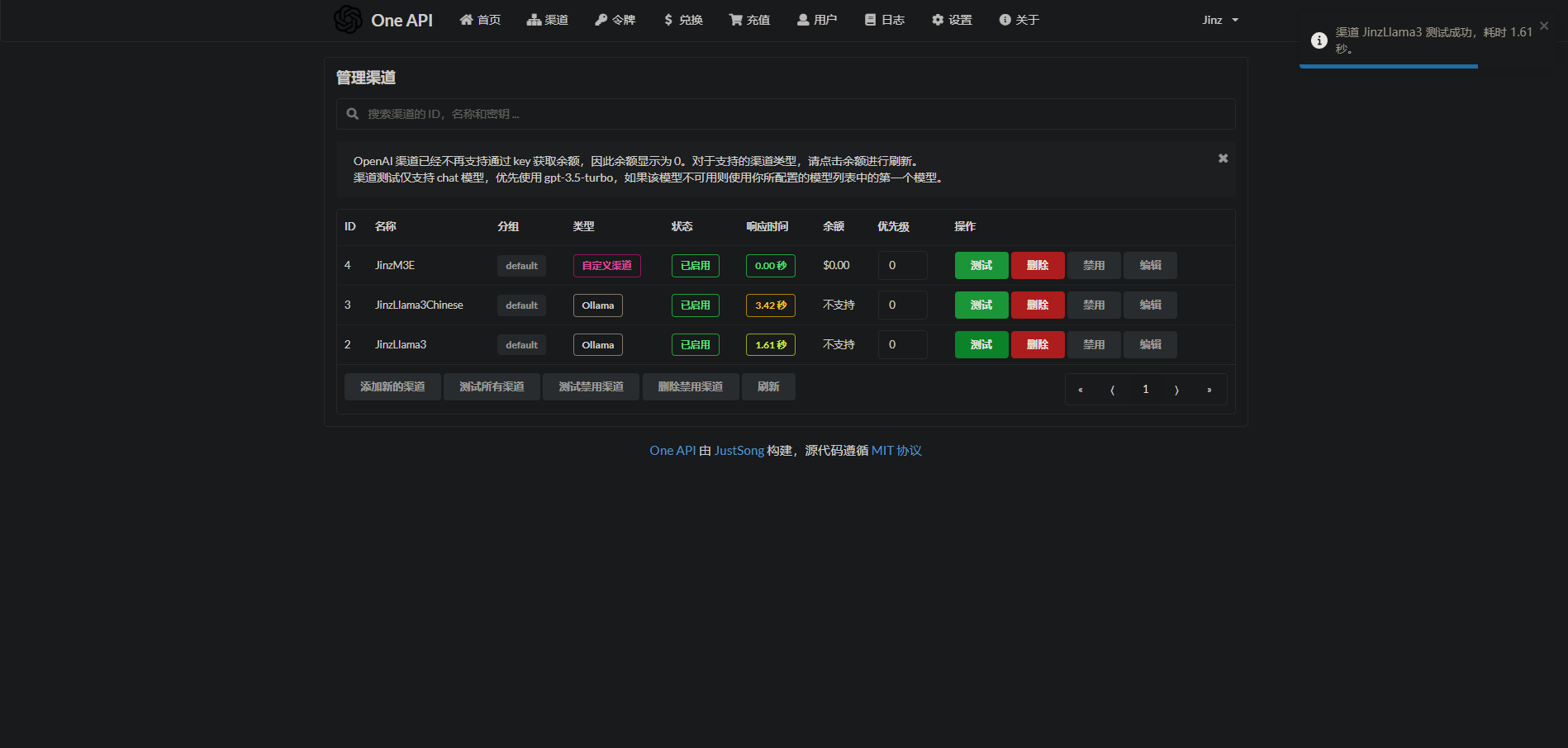

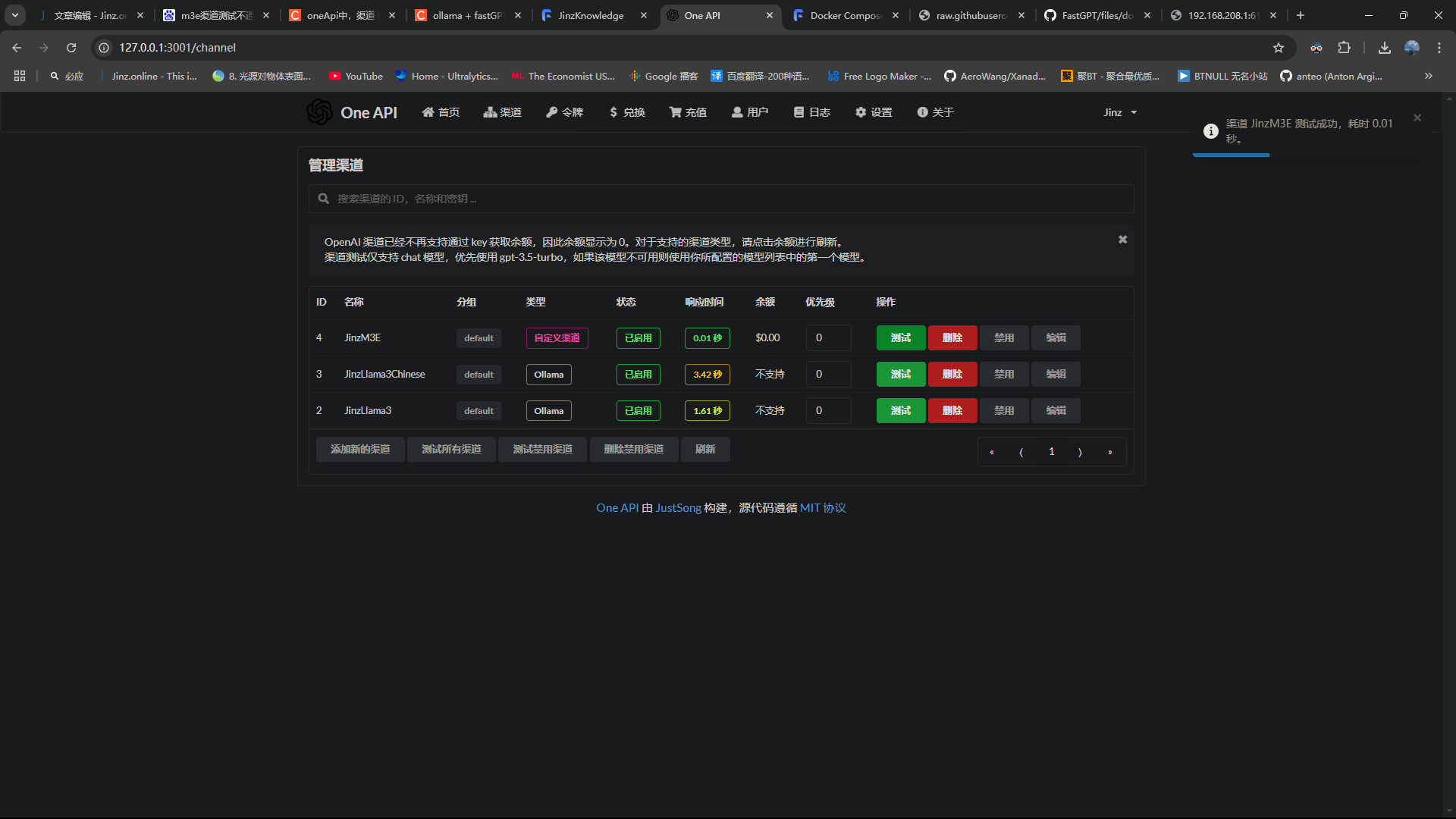

4.3.Llama3渠道测试

4.4.m3e渠道测试

4.5.令牌创建

4.6.修改docker-compose.yml和config.json

修改docker-compose.yml中的OPENAI_BASE_URL和CHAT_API_KEY(对应上文中的令牌创建)字段,如上文第二节所示,不再赘述。

修改config.json中的llmModels和vectorModels,如上文第二节中所示,不再赘述。

修改完成后,cmd执行:

docker-compose up -d5.配置FastGPT

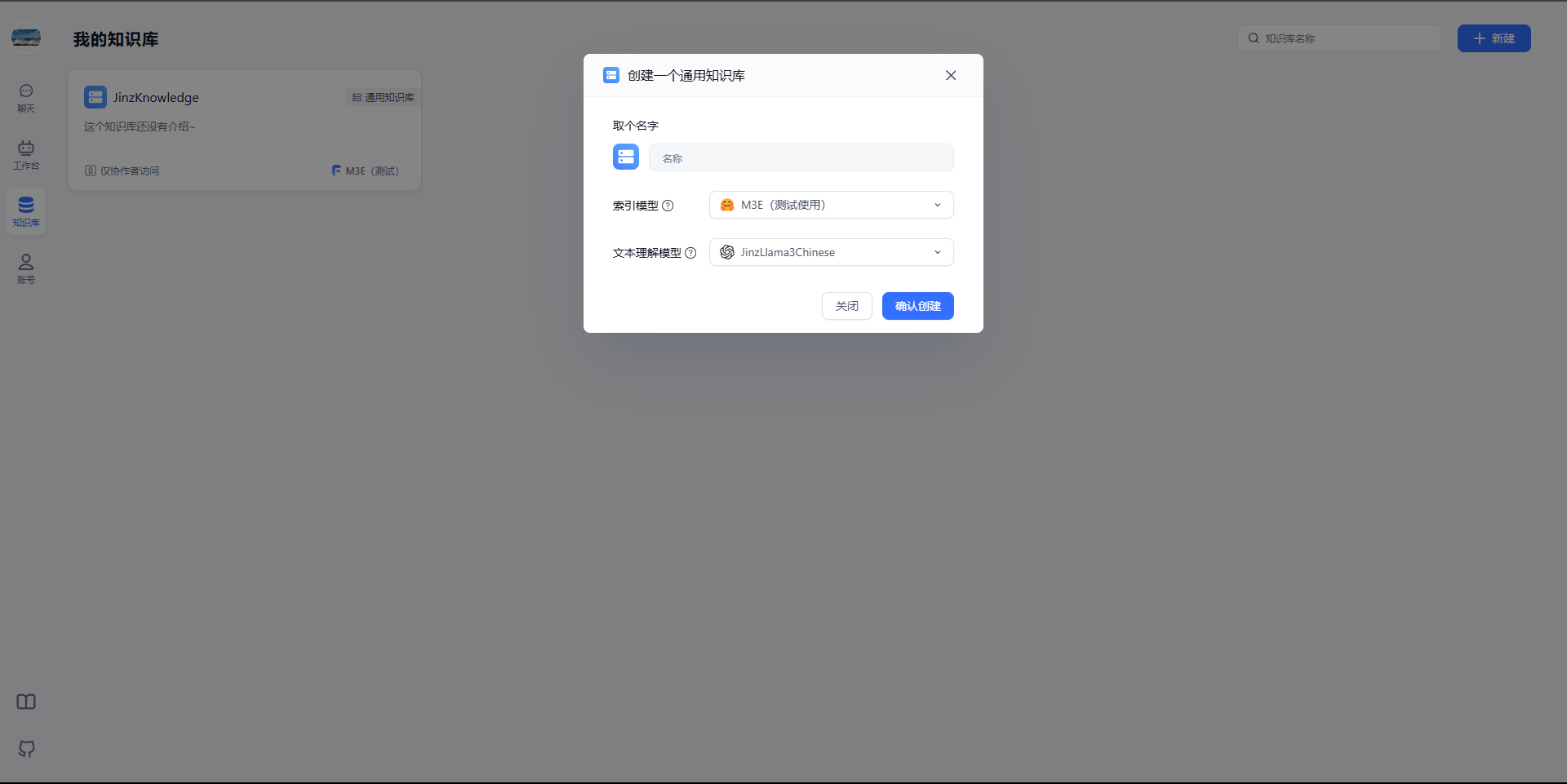

5.1创建知识库

此处索引模型选择M3E,文本理解模型选择我们部署的Llama3。

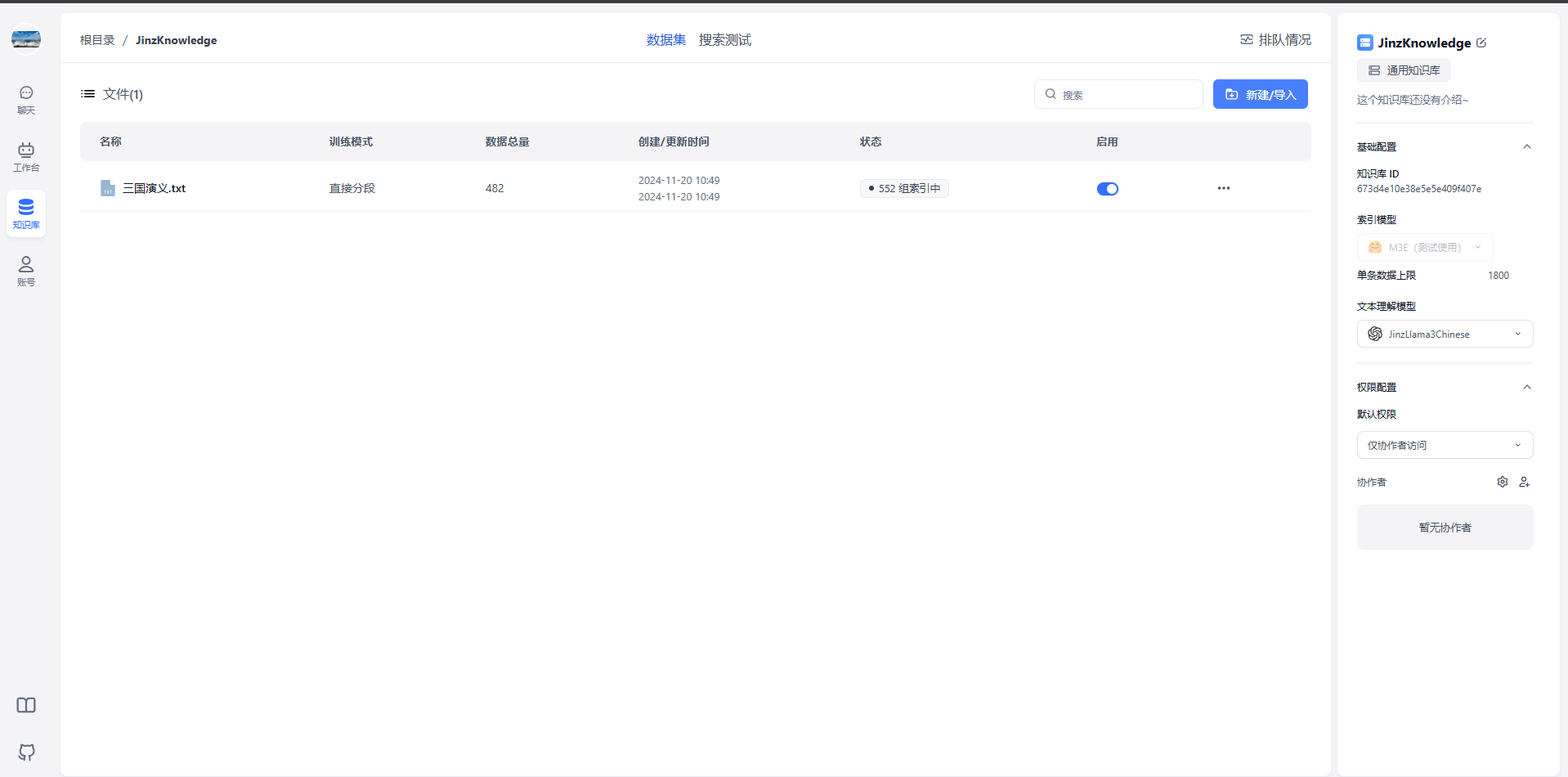

5.2新建文本数据集

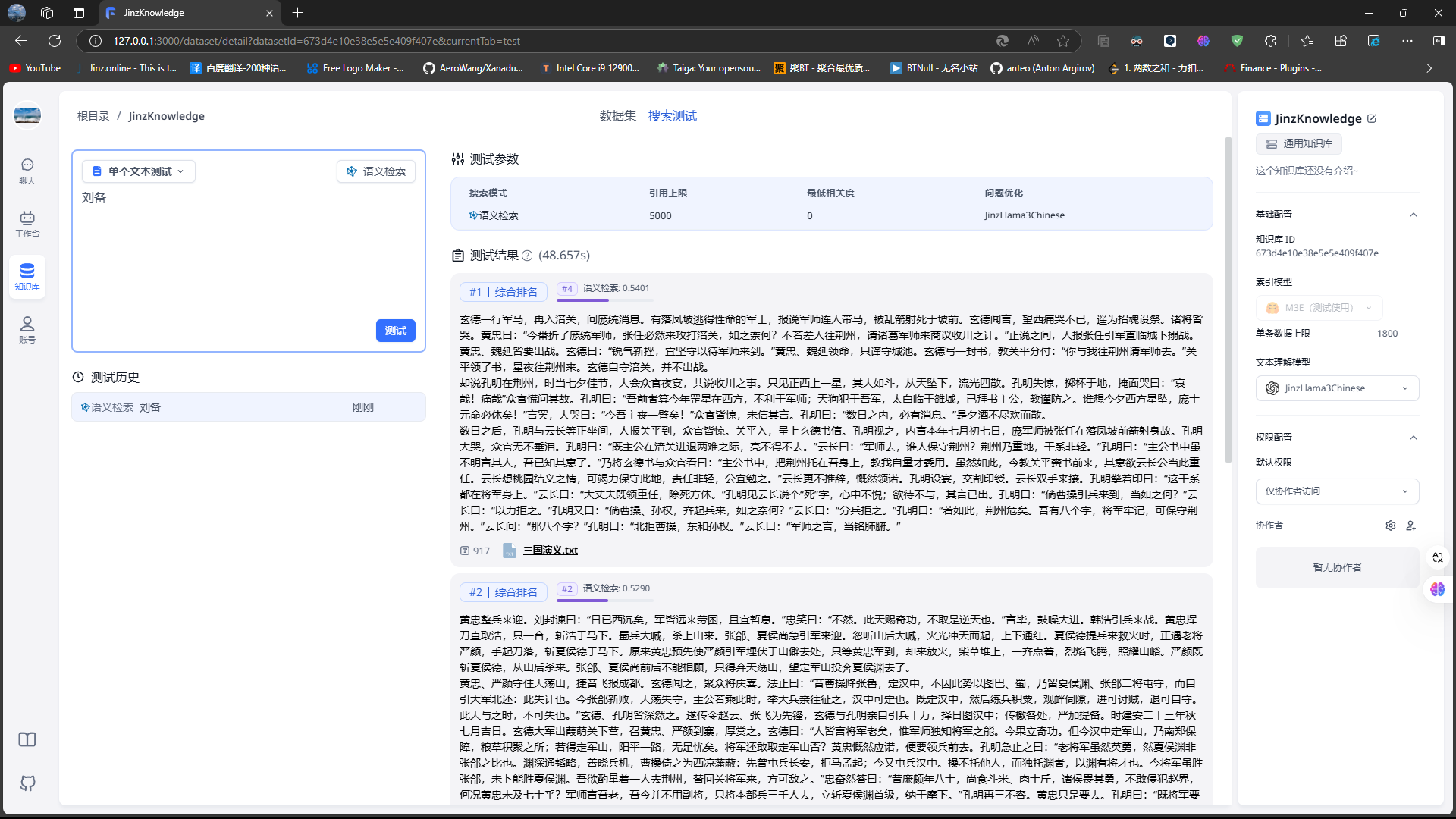

5.3搜索测试

下图可以看到,搜索结果还不错。

5.4应用关联知识库

在工作台创建一个简单应用,然后在关联知识库添加自己的知识库。

6.总结

现在本地部署私有化大模型,打造私有化知识库的方案已经非常成熟,这只是其中一种方案。但是从中可以看到AI的应用潜力巨大,未来可期😄👍。

但是看到上面的问答结果其实细看就知道某些内容其实有错漏(猜测跟我这个三国演义.txt是文言文有关),这个需要模型的微调(Fine-tuning),待研究后再做记录。